U ovom ćemo članku raspravljati o tome kako dodijeliti DRUGAČIJI memorije putem ' pytorch_cuda_alloc_conf ” metoda.

Što je metoda “pytorch_cuda_alloc_conf” u PyTorchu?

U osnovi, ' pytorch_cuda_alloc_conf ” je varijabla okoline unutar PyTorch okvira. Ova varijabla omogućuje učinkovito upravljanje raspoloživim procesorskim resursima što znači da se modeli pokreću i daju rezultate u najkraćem mogućem vremenu. Ako se ne izvrši ispravno, ' DRUGAČIJI ' računalna platforma će prikazati ' bez memorije ” pogreška i utječe na vrijeme izvođenja. Modeli koji se trebaju obučavati na velikim količinama podataka ili imaju velike ' veličine serija ” mogu proizvesti pogreške tijekom izvođenja jer zadane postavke možda nisu dovoljne za njih.

' pytorch_cuda_alloc_conf ' varijabla koristi sljedeće ' opcije ” za upravljanje dodjelom resursa:

- domaći : Ova opcija koristi već dostupne postavke u PyTorchu za dodjelu memorije modelu u tijeku.

- max_split_size_mb : Osigurava da nijedan blok koda veći od navedene veličine ne bude podijeljen. Ovo je moćan alat za sprječavanje ' fragmentacija ”. Koristit ćemo ovu opciju za demonstraciju u ovom članku.

- okrugla_snaga2_podjela : Ova opcija zaokružuje veličinu dodjele na najbliži ' snaga 2 ” podjela u megabajtima (MB).

- zaokruživanje_zaobilaznice_prag_mb: Može zaokružiti veličinu dodjele za bilo koji zahtjev uvrštavajući više od navedenog praga.

- prag_odvoza_smeća : Sprječava kašnjenje korištenjem dostupne memorije iz GPU-a u stvarnom vremenu kako bi se osiguralo da se ne pokrene protokol povrata svega.

Kako dodijeliti memoriju pomoću metode “pytorch_cuda_alloc_conf”?

Svaki model s velikim skupom podataka zahtijeva dodatnu dodjelu memorije koja je veća od one postavljene prema zadanim postavkama. Prilagođenu dodjelu treba specificirati uzimajući u obzir zahtjeve modela i dostupne hardverske resurse.

Slijedite dolje navedene korake za korištenje ' pytorch_cuda_alloc_conf ” u Google Colab IDE za dodjelu više memorije složenom modelu strojnog učenja:

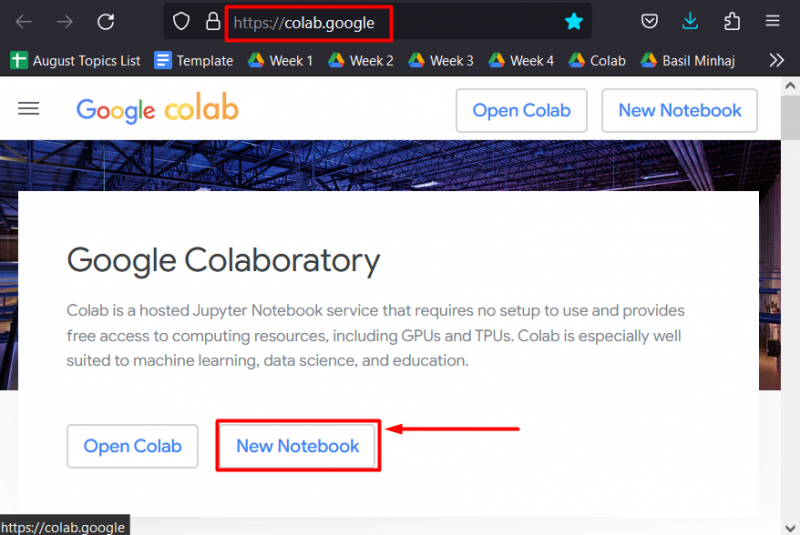

Korak 1: Otvorite Google Colab

Traži Google Suradnički u pregledniku i stvorite ' Nova bilježnica ” za početak rada:

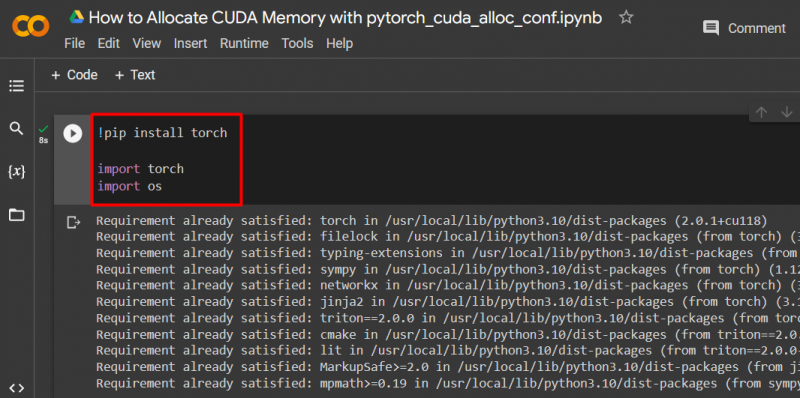

Korak 2: Postavite prilagođeni PyTorch model

Postavite PyTorch model pomoću ' !pip ' instalacijski paket za instaliranje ' baklja ' knjižnica i ' uvoz 'naredba za uvoz' baklja ' i ' vas ” knjižnica u projekt:

uvozna baklja

uvezi nas

Za ovaj projekt potrebne su sljedeće biblioteke:

- Baklja – Ovo je temeljna biblioteka na kojoj se temelji PyTorch.

- VAS – ' operacijski sustav ” knjižnica se koristi za rukovanje zadacima koji se odnose na varijable okruženja kao što su „ pytorch_cuda_alloc_conf ”, kao i sistemski direktorij i dopuštenja za datoteke:

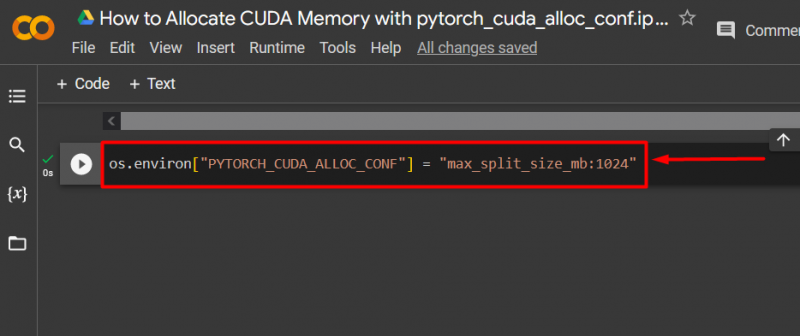

Korak 3: Dodijelite CUDA memoriju

Koristiti ' pytorch_cuda_alloc_conf ' za određivanje maksimalne veličine dijeljenja pomoću ' max_split_size_mb ”:

Korak 4: Nastavite s projektom PyTorch

Nakon navođenja ' DRUGAČIJI ” dodjela prostora s “ max_split_size_mb ' opciju, nastavite raditi na PyTorch projektu kao i obično bez straha od ' bez memorije ” pogreška.

Bilješka : Našoj Google Colab bilježnici možete pristupiti ovdje veza .

Stručni savjet

Kao što je ranije spomenuto, ' pytorch_cuda_alloc_conf ” može uzeti bilo koju od gore navedenih opcija. Koristite ih u skladu sa specifičnim zahtjevima vaših projekata dubokog učenja.

Uspjeh! Upravo smo pokazali kako koristiti ' pytorch_cuda_alloc_conf ' metoda za određivanje ' max_split_size_mb ” za PyTorch projekt.

Zaključak

Koristiti ' pytorch_cuda_alloc_conf ” za dodjelu CUDA memorije korištenjem bilo koje od dostupnih opcija prema zahtjevima modela. Svaka od ovih opcija namijenjena je ublažavanju određenog problema s obradom unutar PyTorch projekata radi boljeg vremena izvođenja i glatkijih operacija. U ovom smo članku prikazali sintaksu za korištenje ' max_split_size_mb ” za definiranje maksimalne veličine podjele.