Funkcija pipeline() sastavni je dio biblioteke Transformer. Potrebno je nekoliko inputa u kojima možemo definirati zadatak zaključivanja, modele, mehanizam tokenizacije itd. Funkcija pipeline() uglavnom se koristi za izvođenje NLP zadataka na jednom ili više tekstova. Izvodi predobradu na ulazu i naknadnu obradu na temelju modela kako bi se generirao čovjeku čitljiv izlaz i točno predviđanje s maksimalnom točnošću.

Ovaj članak pokriva sljedeće aspekte:

Što je Hugging Face Dataset Library?

Biblioteka skupova podataka Hugging Face je API koji sadrži nekoliko javnih skupova podataka i pruža jednostavan način za njihovo preuzimanje. Ova biblioteka se može uvesti i instalirati u aplikaciju pomoću ' pip ” naredba. Za praktičnu demonstraciju preuzimanja i instaliranja skupova podataka biblioteke Hugging Face, posjetite ovo Google Colab veza. Možete preuzeti više skupova podataka s Hugging Face Dataset Hub.

Saznajte više o funkcioniranju funkcije pipeline() u ovom članku “ Kako iskoristiti funkciju Pipeline() u transformatorima? ”.

Kako primijeniti cjevovode na skup podataka u Hugging Face?

Hugging Face pruža nekoliko različitih javnih skupova podataka koji se lako mogu instalirati pomoću koda u jednom retku. U ovom ćemo članku vidjeti praktičnu demonstraciju primjene cjevovoda na te skupove podataka. Postoje dva načina na koje se cjevovodi mogu implementirati na skup podataka.

Metoda 1: Korištenje metode ponavljanja

Funkcija pipeline() također se može ponoviti preko skupa podataka i modela. U tu svrhu slijedite dolje navedene korake:

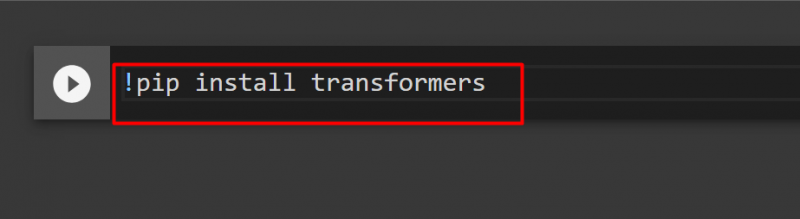

Korak 1: Instalirajte Transformer Library

Da biste instalirali biblioteku Transformer, unesite sljedeću naredbu:

!pip ugraditi transformatore

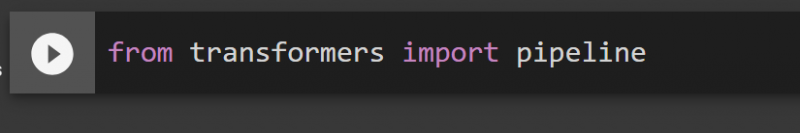

Korak 2: Uvezite cjevovode

Cjevovod možemo uvesti iz biblioteke Transformer. U tu svrhu navedite sljedeću naredbu:

iz transformatora uvozni cjevovod

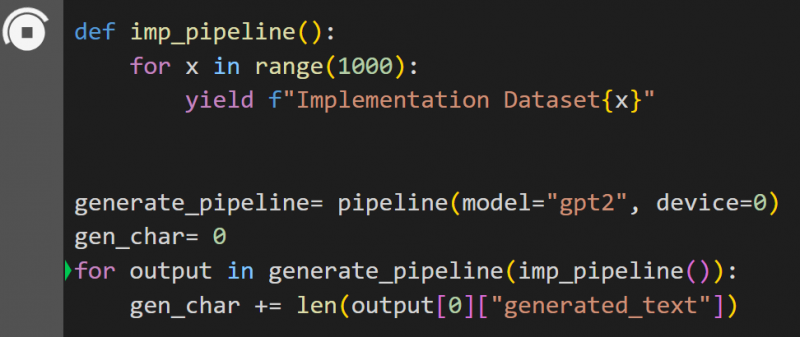

Korak 3: Implementirajte cjevovod

Ovdje je funkcija pipeline() implementirana na modelu ' gpt2 ”. Modele možete preuzeti s Središte modela grljenog lica:

def imp_pipeline():za x u rasponu (1000):

yield f'Skup podataka implementacije{x}'

generiranje_cjevovoda= cjevovod(model='gpt2', uređaj=0)

gen_char= 0

za izlaz u generate_pipeline(imp_pipeline()):

gen_char += len(output[0]['generated_text'])

U ovom kodu, ' generirati_cjevovod ” je varijabla koja sadrži funkciju pipeline() s modelom “ gpt2 ”. Kada se pozove s ' imp_pipeline() ”, automatski prepoznaje podatke koji su povećani s rasponom navedenim na 1000:

Ovo će trebati neko vrijeme za treniranje. Veza na Google Co je također dano.

Metoda 2: Korištenje biblioteke skupova podataka

U ovoj metodi, demonstrirat ćemo implementaciju cjevovoda pomoću biblioteke 'setova podataka':

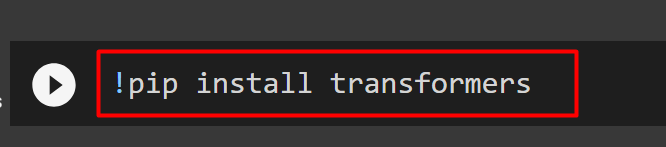

Korak 1: Instalirajte Transformer

Da biste instalirali biblioteku Transformer, unesite sljedeću naredbu:

!pip ugraditi transformatore

Korak 2: Instalirajte biblioteku skupova podataka

kao ' skupovi podataka ” sadrži sve javne skupove podataka, možemo je instalirati pomoću sljedeće naredbe. Instaliranjem ' skupovi podataka ” biblioteke, možemo izravno uvesti bilo koji skup podataka dajući njegov naziv:

!pip instalirajte skupove podataka

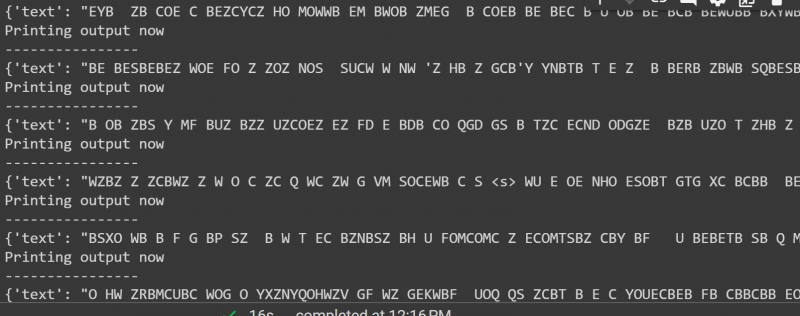

Korak 3: Cjevovod skupa podataka

Za izgradnju cjevovoda na skupu podataka upotrijebite sljedeći kod. KeyDataset je značajka koja ispisuje samo one vrijednosti koje zanimaju korisnika:

iz transformers.pipelines.pt_utils import KeyDatasetiz transformatora uvozni cjevovod

iz skupova podataka import load_dataset

gen_pipeline = cjevovod(model='hf-internal-testing/tiny-random-wav2vec2', device=0)

loaddataset = load_dataset('hf-internal-testing/librispeech_asr_dummy', 'clean', split='validation[:10]')za izlaz u gen_pipeline(KeyDataset(loaddataset, 'audio')):

print('Ispis izlaza sada')

ispis ('----------------')

ispis (izlaz)

Izlaz gornjeg koda dan je u nastavku:

To je sve iz ovog vodiča. Veza na Google Co također se spominje u ovom članku

Zaključak

Da bismo primijenili cjevovode na skup podataka, možemo iterirati preko skupa podataka pomoću funkcije pipeline() ili koristiti ' skupovi podataka ” knjižnica. Hugging Face svojim korisnicima pruža vezu GitHub repozitorija za skupove podataka i modele koji se mogu koristiti na temelju zahtjeva. Ovaj članak pruža opsežan vodič za primjenu cjevovoda na skupu podataka u Transformersu.