Kako koristiti prozor međuspremnika razgovora u LangChainu?

Prozor međuspremnika razgovora koristi se za čuvanje najnovijih poruka razgovora u memoriji kako bi se dobio najnoviji kontekst. Koristi vrijednost K za pohranjivanje poruka ili nizova u memoriju pomoću okvira LangChain.

Kako biste naučili postupak korištenja prozora međuspremnika razgovora u LangChainu, jednostavno prođite kroz sljedeći vodič:

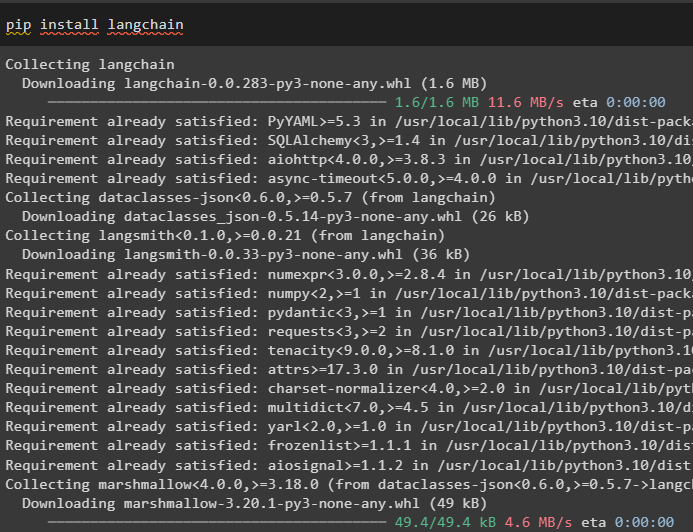

Korak 1: Instalirajte module

Započnite postupak korištenja prozora međuspremnika razgovora instaliranjem modula LangChain s potrebnim ovisnostima za izgradnju modela razgovora:

pip instalirati langchain

Nakon toga instalirajte OpenAI modul koji se može koristiti za izgradnju velikih jezičnih modela u LangChainu:

pip instaliraj openai

Sada, postaviti OpenAI okruženje za izgradnju LLM lanaca pomoću API ključa s OpenAI računa:

uvoz vas

uvoz getpass

vas . približno [ 'OPENAI_API_KEY' ] = getpass . getpass ( 'OpenAI API ključ:' )

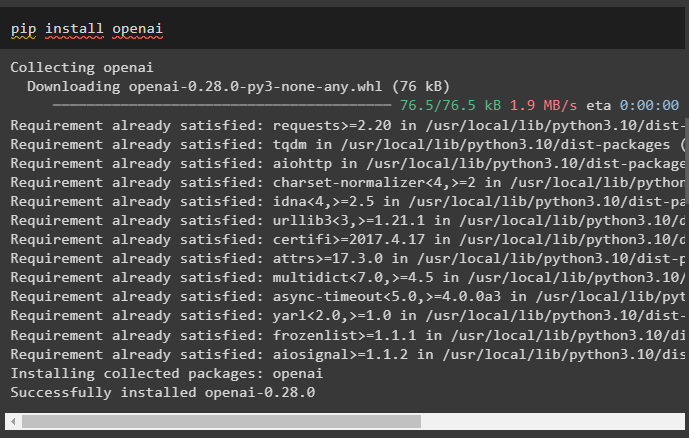

Korak 2: Korištenje memorije prozora međuspremnika razgovora

Za korištenje memorije prozora međuspremnika razgovora u LangChainu, uvezite ConversationBufferWindowMemory knjižnica:

iz langchain. memorija uvoz ConversationBufferWindowMemoryKonfigurirajte memoriju pomoću ConversationBufferWindowMemory () metoda s vrijednošću k kao argumentom. Vrijednost k koristit će se za čuvanje najnovijih poruka iz razgovora i zatim konfiguriranje podataka o obuci pomoću ulaznih i izlaznih varijabli:

memorija = ConversationBufferWindowMemory ( k = 1 )memorija. spremi_kontekst ( { 'ulazni' : 'zdravo' } , { 'izlaz' : 'Kako si' } )

memorija. spremi_kontekst ( { 'ulazni' : 'Ja sam dobar, a ti' } , { 'izlaz' : 'ne mnogo' } )

Testirajte memoriju pozivom na load_memory_variables () metoda za početak razgovora:

memorija. load_memory_variables ( { } )

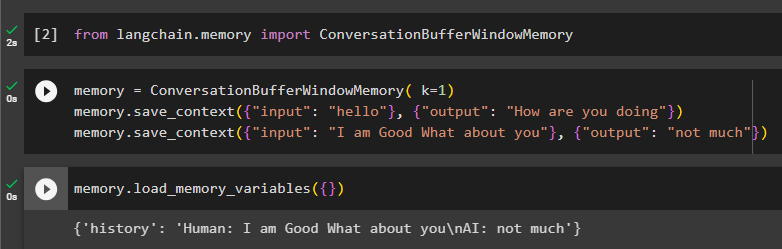

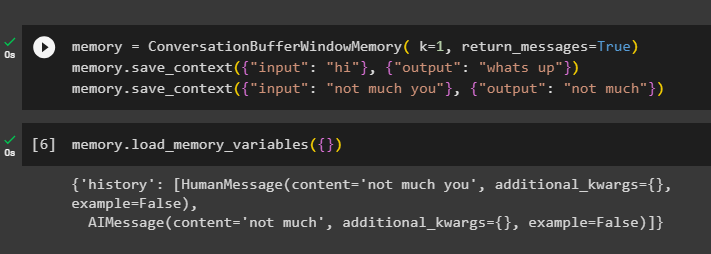

Da biste dobili povijest razgovora, konfigurirajte funkciju ConversationBufferWindowMemory() pomoću povratne_poruke argument:

memorija = ConversationBufferWindowMemory ( k = 1 , povratne_poruke = Pravi )memorija. spremi_kontekst ( { 'ulazni' : 'bok' } , { 'izlaz' : 'što ima' } )

memorija. spremi_kontekst ( { 'ulazni' : 'ne baš ti' } , { 'izlaz' : 'ne mnogo' } )

Sada pozovite memoriju pomoću load_memory_variables () metoda za dobivanje odgovora s poviješću razgovora:

memorija. load_memory_variables ( { } )

Korak 3: Korištenje prozora međuspremnika u lancu

Izgradite lanac pomoću OpenAI i Lanac razgovora biblioteke, a zatim konfigurirajte međuspremnik za pohranjivanje najnovijih poruka u razgovoru:

iz langchain. lanci uvoz Lanac razgovoraiz langchain. llms uvoz OpenAI

#izrada sažetka razgovora pomoću više parametara

razgovor_sa_sažetkom = Lanac razgovora (

llm = OpenAI ( temperatura = 0 ) ,

#building memorijski međuspremnik koristeći njegovu funkciju s vrijednošću k za pohranu nedavnih poruka

memorija = ConversationBufferWindowMemory ( k = 2 ) ,

#configure verbose varijablu da biste dobili čitljiviji izlaz

opširno = Pravi

)

razgovor_sa_sažetkom. predvidjeti ( ulazni = 'Hej što ima' )

Sada nastavite razgovor postavljanjem pitanja u vezi s rezultatom koji daje model:

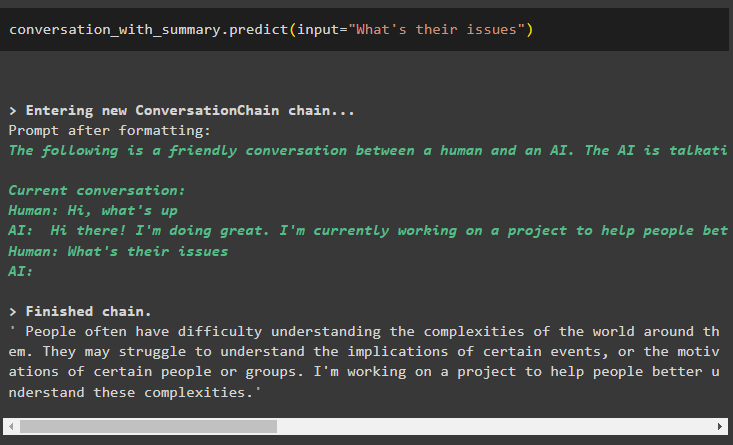

razgovor_sa_sažetkom. predvidjeti ( ulazni = 'Koji su njihovi problemi' )

Model je konfiguriran za pohranu samo jedne prethodne poruke koja se može koristiti kao kontekst:

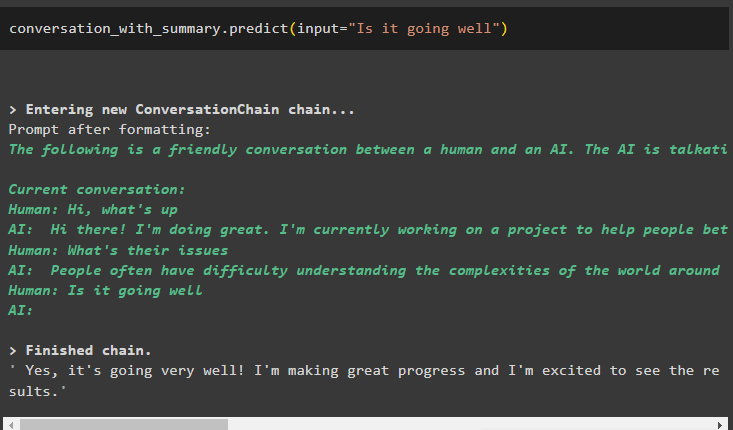

razgovor_sa_sažetkom. predvidjeti ( ulazni = 'Ide li dobro' )

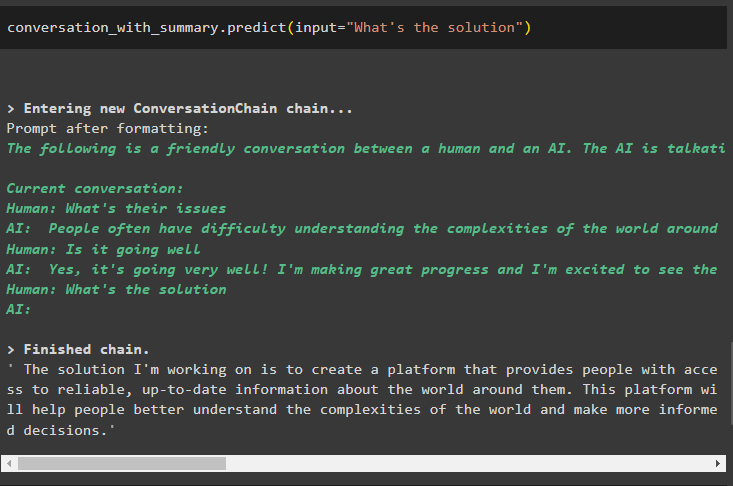

Zatražite rješenje problema i izlazna struktura nastavit će kliziti kroz prozor međuspremnika uklanjanjem ranijih poruka:

razgovor_sa_sažetkom. predvidjeti ( ulazni = 'Koje je rješenje' )

To je sve o procesu korištenja međuspremnika za razgovore Windows LangChain.

Zaključak

Da biste koristili memoriju prozora međuspremnika razgovora u LangChainu, jednostavno instalirajte module i postavite okruženje pomoću API ključa OpenAI-ja. Nakon toga izgradite međuspremnik pomoću vrijednosti k da biste zadržali najnovije poruke u razgovoru kako biste zadržali kontekst. Međuspremnik se također može koristiti s lancima za poticanje razgovora s LLM-om ili lancem. Ovaj vodič razradio je postupak korištenja prozora međuspremnika razgovora u LangChainu.