LangChain je okvir s aplikacijom u domeni obrade prirodnog jezika ili NLP za izgradnju modela na jezicima sličnim ljudima. Ljudi mogu koristiti ove modele da dobiju odgovore od modela ili da vode razgovor kao bilo koji drugi čovjek. LangChain se koristi za izgradnju lanaca pohranjivanjem svake rečenice u razgovoru i daljnjom interakcijom koristeći je kao kontekst.

Ovaj post će ilustrirati proces izgradnje LLM i LLMChaina u LangChainu.

Kako izgraditi LLM i LLMChain u LangChainu?

Da biste izgradili LLM i LLMChain u LangChainu, jednostavno prođite kroz navedene korake:

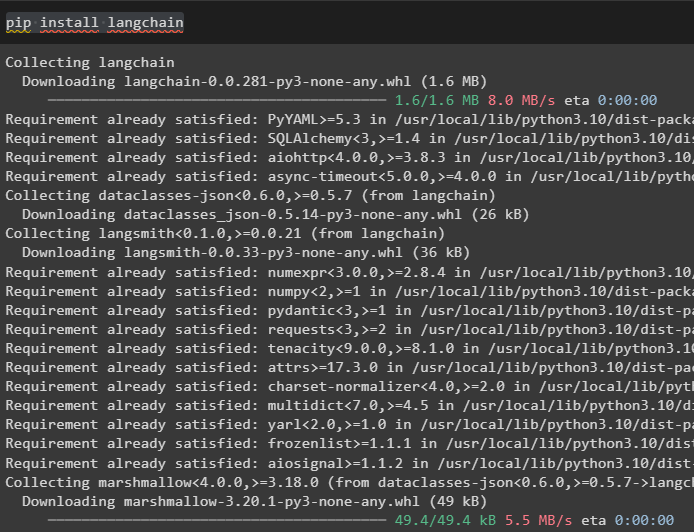

Korak 1: Instalirajte module

Najprije instalirajte modul LangChain da biste koristili njegove biblioteke za izgradnju LLM-a i LLMChaina:

pip instalirati langchain

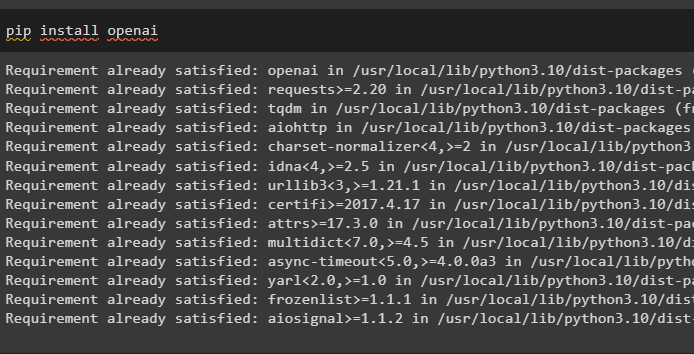

Drugi modul koji je potreban za izgradnju LLM-ova je OpenAI, a može se instalirati pomoću naredbe pip:

pip instaliraj openai

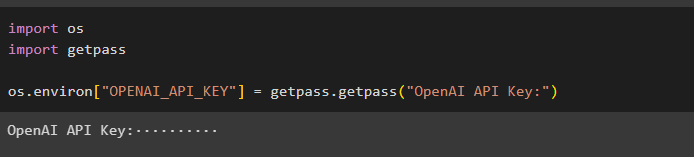

Korak 2: Postavite okruženje

Postavite okruženje koristeći OpenAI API ključ iz njegovog okruženja:

uvezi nasimport getpassos.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API ključ:')

Primjer 1: Izgradite LLM-ove koristeći LangChain

Prvi primjer je izgradnja velikih jezičnih modela pomoću LangChaina uvozom OpenAI i ChatOpenAI biblioteka i korištenjem funkcije llm():

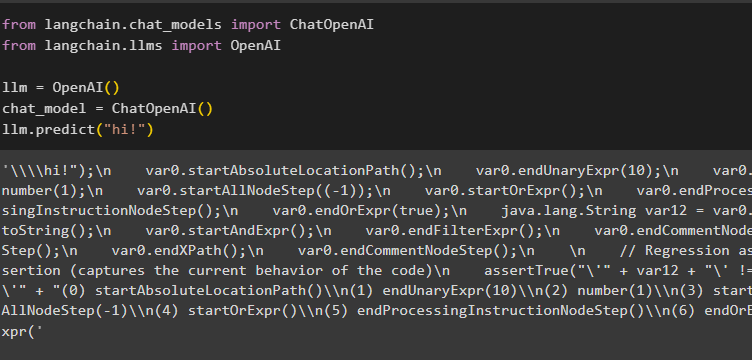

Korak 1: Korištenje LLM Chat modela

Uvezite OpenAI i ChatOpenAI module za izgradnju jednostavnog LLM-a koristeći OpenAI okruženje iz LangChaina:

iz langchain.chat_models uvesti ChatOpenAIiz langchain.llms uvozi OpenAI

llm = OpenAI()

chat_model = ChatOpenAI()

llm.predict('bok!')

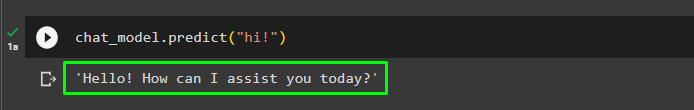

Model je odgovorio odgovorom 'bok' kao što je prikazano na sljedećoj snimci zaslona u nastavku:

Funkcija predict() iz chat_modela koristi se za dobivanje odgovora ili odgovora iz modela:

chat_model.predict('bok!')Izlaz pokazuje da je model na raspolaganju korisniku koji postavlja upite:

2. korak: korištenje tekstualnog upita

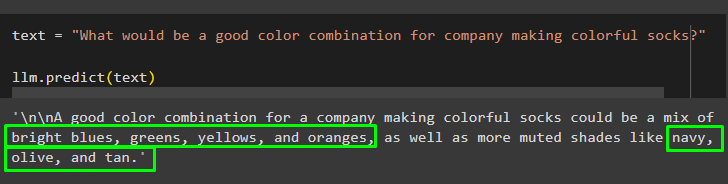

Korisnik također može dobiti odgovore iz modela davanjem cijele rečenice u tekstualnu varijablu:

text = 'Koje bi bilo dobro ime za tvrtku koja proizvodi šarene čarape?'llm.predict(tekst)

Model je prikazao više kombinacija boja za šarene čarape:

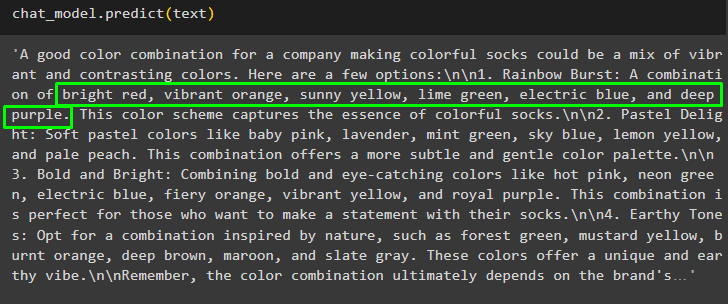

Dobijte detaljan odgovor od modela pomoću funkcije predict() s kombinacijama boja za čarape:

chat_model.predict(tekst)

Korak 3: Korištenje teksta sa sadržajem

Korisnik može dobiti odgovor uz malo objašnjenje odgovora:

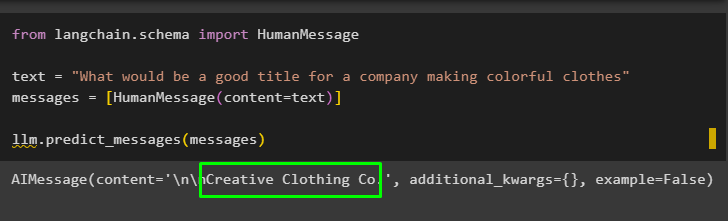

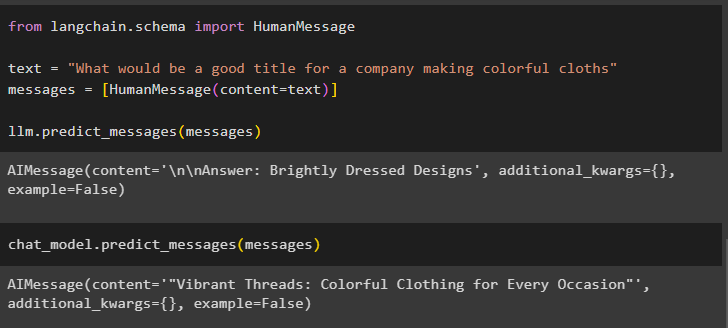

iz langchain.schema import HumanMessagetext = 'Koji bi bio dobar naslov za tvrtku koja proizvodi šarenu odjeću'

poruke = [HumanMessage(content=text)]

llm.predict_messages(poruke)

Model je generirao naslov za tvrtku koja je 'Creative Clothing Co':

Predvidite poruku kako biste dobili odgovor i za naziv tvrtke uz njezino objašnjenje:

chat_model.predict_messages(poruke)

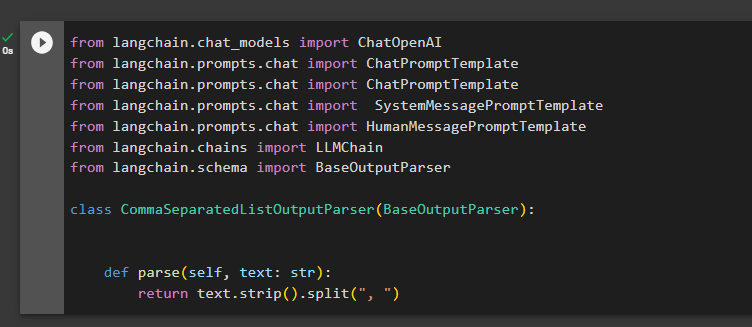

Primjer 2: Izgradite LLMChain koristeći LangChain

Drugi primjer našeg vodiča gradi LLMChain kako bi se dobio model u formatu ljudske interakcije kako bi se kombinirali svi koraci iz prethodnog primjera:

iz langchain.chat_models uvesti ChatOpenAIiz langchain.prompts.chat import ChatPromptTemplate

iz langchain.prompts.chat import ChatPromptTemplate

from langchain.prompts.chat import SystemMessagePromptTemplatfrom langchain.prompts.chat import HumanMessagePromptTemplate

iz langchain.chains import LLMChain

iz langchain.schema import BaseOutputParserclass CommaSeparatedListOutputParser(BaseOutputParser):

def parse(self, text: str):

vrati tekst.strip().split(', ')

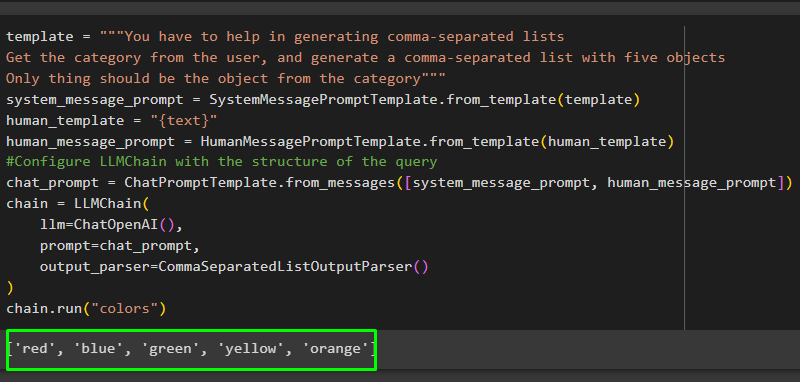

Izgradite predložak za model chata dajući detaljno objašnjenje njegovog rada, a zatim izgradite funkciju LLMChain() koja sadrži LLM, izlazni parser i chat_prompt biblioteke:

predložak = '''Morate pomoći u generiranju popisa odvojenih zarezimaDobijte kategoriju od korisnika i generirajte popis odijeljen zarezima s pet objekata

Jedino bi trebao biti objekt iz kategorije'''

system_message_prompt = SystemMessagePromptTemplate.from_template(template)

ljudski_predložak = '{tekst}'

human_message_prompt = HumanMessagePromptTemplate.from_template(human_template)

#Konfigurirajte LLMChain sa strukturom upita

chat_prompt = ChatPromptTemplate.from_messages([system_message_prompt, human_message_prompt])

lanac = LLMChain(

llm=ChatOpenAI(),

prompt=chat_prompt,

output_parser=CommaSeparatedListOutputParser()

)

chain.run('boje')

Model je dao odgovor s popisom boja jer bi kategorija trebala sadržavati samo 5 objekata navedenih u upitu:

To je sve o izgradnji LLM i LLMChaina u LangChainu.

Zaključak

Da biste izgradili LLM i LLMChain koristeći LangChain, jednostavno instalirajte LangChain i OpenAI module kako biste postavili okruženje koristeći njegov API ključ. Nakon toga, izgradite LLM model koristeći chat_model nakon stvaranja predloška upita za jedan upit za cijeli chat. LLMChain se koristi za izgradnju lanaca svih zapažanja u razgovoru i njihovu upotrebu kao kontekst interakcije. Ovaj post ilustrira proces izgradnje LLM i LLMChaina pomoću okvira LangChain.